Workflows d'Agents IA Type-Safe avec Performance Rust

🚧 Traduction en cours - Ce document est en cours de traduction depuis l'anglais.

📖 Read in English | Lire en anglais

Lire dans d'autres langues: 🇨🇳 简体中文 | 🇨🇳 繁體中文 | 🇪🇸 Español | 🇩🇪 Deutsch | 🇯🇵 日本語 | 🇰🇷 한국어 | 🇮🇳 हिन्दी | 🇸🇦 العربية | 🇮🇹 Italiano | 🇧🇷 Português | 🇷🇺 Русский | 🇧🇩 বাংলা

GraphBit est un framework IA agentique open-source pour les développeurs qui ont besoin d'une exécution déterministe, concurrente et à faible surcharge.

L'efficacité décide qui peut évoluer. GraphBit est conçu pour les développeurs qui ont besoin d'une exécution IA déterministe, concurrente et ultra-efficace sans surcharge.

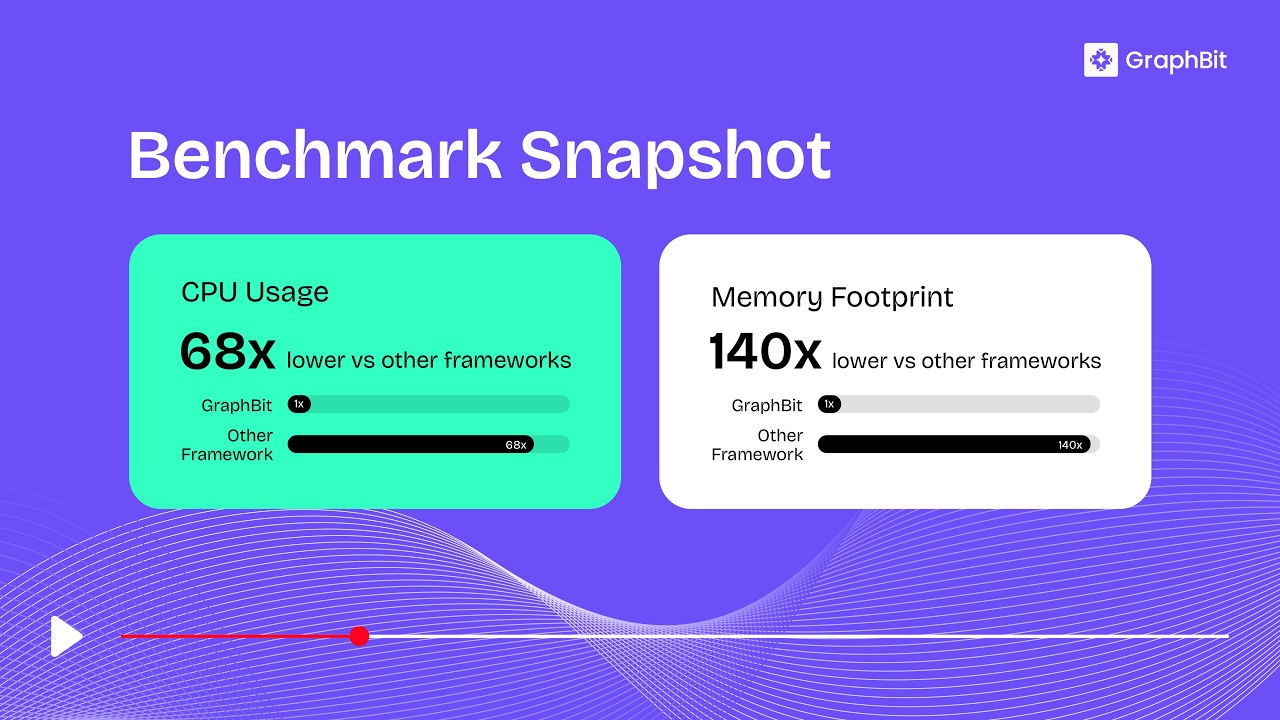

Construit avec un noyau Rust et une couche Python minimale, GraphBit offre jusqu'à 68× moins d'utilisation CPU et 140× moins d'empreinte mémoire que d'autres frameworks, tout en maintenant un débit égal ou supérieur.

Il alimente des workflows multi-agents qui s'exécutent en parallèle, persistent la mémoire entre les étapes, se récupèrent automatiquement des pannes et garantissent 100% de fiabilité des tâches. GraphBit est conçu pour les charges de travail de production, des systèmes IA d'entreprise aux déploiements edge à ressources limitées.

- Sélection d'Outils - Les LLM choisissent intelligemment les outils en fonction des descriptions

- Sécurité des Types - Typage fort à travers chaque couche d'exécution

- Fiabilité - Disjoncteurs, politiques de réessai, gestion des erreurs et récupération des pannes

- Support Multi-LLM - OpenAI, Azure OpenAI, Anthropic, OpenRouter, DeepSeek, Replicate, Ollama, TogetherAI et plus

- Gestion des Ressources - Contrôles de concurrence et optimisation de la mémoire

- Observabilité - Traçage intégré, logs structurés et métriques de performance

GraphBit a été conçu pour l'efficacité à grande échelle, non pas des affirmations théoriques, mais des résultats mesurés.

Notre suite de benchmarks interne a comparé GraphBit aux principaux frameworks d'agents basés sur Python sur des charges de travail identiques.

| Métrique | GraphBit | Autres Frameworks | Gain |

|---|---|---|---|

| Utilisation CPU | 1.0× base | 68.3× supérieur | ~68× CPU |

| Empreinte Mémoire | 1.0× base | 140× supérieur | ~140× Mémoire |

| Vitesse d'Exécution | ≈ égal / plus rapide | — | Débit cohérent |

| Déterminisme | 100% succès | Variable | Fiabilité garantie |

GraphBit offre systématiquement une efficacité de niveau production pour les appels LLM, les invocations d'outils et les chaînes multi-agents.

Choisissez GraphBit si vous avez besoin de :

- Systèmes multi-agents de niveau production qui ne s'effondrent pas sous la charge

- Exécution type-safe et sorties reproductibles

- Orchestration en temps réel pour applications IA hybrides ou en streaming

- Efficacité niveau Rust avec ergonomie niveau Python

Si vous dépassez les prototypes ou si le déterminisme d'exécution vous importe, GraphBit est fait pour vous.

Il est recommandé d'utiliser un environnement virtuel.

pip install graphbitConfigurez les clés API que vous souhaitez utiliser dans votre projet :

# OpenAI (optionnel – requis si vous utilisez des modèles OpenAI)

export OPENAI_API_KEY=your_openai_api_key_here

# Anthropic (optionnel – requis si vous utilisez des modèles Anthropic)

export ANTHROPIC_API_KEY=your_anthropic_api_key_hereNote de Sécurité : Ne validez jamais les clés API dans le contrôle de version. Utilisez toujours des variables d'environnement ou une gestion sécurisée des secrets.

import os

from graphbit import LlmConfig, Executor, Workflow, Node, tool

# Initialiser et configurer

config = LlmConfig.openai(os.getenv("OPENAI_API_KEY"), "gpt-4o-mini")

# Créer l'exécuteur

executor = Executor(config)

# Créer des outils avec des descriptions claires pour la sélection du LLM

@tool(_description="Obtenir les informations météorologiques actuelles pour n'importe quelle ville")

def get_weather(location: str) -> dict:

return {"location": location, "temperature": 22, "condition": "sunny"}

@tool(_description="Effectuer des calculs mathématiques et renvoyer les résultats")

def calculate(expression: str) -> str:

return f"Result: {eval(expression)}"

# Construire le flux de travail

workflow = Workflow("Analysis Pipeline")

# Créer des nœuds d'agent

smart_agent = Node.agent(

name="Smart Agent",

prompt="What's the weather in Paris and calculate 15 + 27?",

system_prompt="You are an assistant skilled in weather lookup and math calculations. Use tools to answer queries accurately.",

tools=[get_weather, calculate]

)

processor = Node.agent(

name="Data Processor",

prompt="Process the results obtained from Smart Agent.",

system_prompt="""You process and organize results from other agents.

- Summarize and clarify key points

- Structure your output for easy reading

- Focus on actionable insights

"""

)

# Connecter et exécuter

id1 = workflow.add_node(smart_agent)

id2 = workflow.add_node(processor)

workflow.connect(id1, id2)

result = executor.execute(workflow)

print(f"Workflow completed: {result.is_success()}")

print("\nSmart Agent Output: \n", result.get

6C08

_node_output("Smart Agent"))

print("\nData Processor Output: \n", result.get_node_output("Data Processor"))GraphBit Tracer capture et surveille les appels LLM et les flux de travail IA avec une configuration minimale. Il enveloppe les clients LLM GraphBit et les exécuteurs de flux de travail pour tracer les prompts, les réponses, l'utilisation des tokens, la latence et les erreurs sans modifier votre code.

Conception à trois niveaux pour la fiabilité et les performances :

- Noyau Rust - Moteur de flux de travail, agents et fournisseurs LLM

- Couche d'Orchestration - Gestion et exécution de projets

- API Python - Liaisons PyO3 avec support asynchrone

GraphBit fournit une API Python riche pour construire et intégrer des flux de travail agentiques :

- Clients LLM - Intégrations LLM multi-fournisseurs (OpenAI, Anthropic, Azure et plus)

- Flux de Travail - Définir et gérer des graphes de flux de travail multi-agents avec gestion d'état

- Nœuds - Nœuds d'agent, nœuds d'outils et composants de flux de travail personnalisés

- Exécuteurs - Moteur d'exécution de flux de travail avec gestion de configuration

- Système d'Outils - Décorateurs de fonctions, registre et framework d'exécution pour les outils d'agent

- Résultats de Flux de Travail - Résultats d'exécution avec métadonnées, timing et accès aux sorties

- Embeddings - Embeddings vectoriels pour la recherche sémantique et la récupération

- Contexte de Flux de Travail - État partagé et variables à travers l'exécution du flux de travail

- Chargeurs de Documents - Charger et analyser des documents de plusieurs formats (PDF, DOCX, TXT, JSON, CSV, XML, HTML)

- Diviseurs de Texte - Diviser les documents en morceaux (caractère, token, phrase, récursif)

Pour la liste complète des classes, méthodes et exemples d'utilisation, consultez la Référence API Python.

Pour la documentation complète, visitez : https://docs.graphbit.ai/

L'architecture modulaire de GraphBit prend en charge les intégrations externes :

| Catégorie | Exemples |

|---|---|

| Fournisseurs LLM | OpenAI, Anthropic, Azure OpenAI, DeepSeek, Together, Ollama, OpenRouter, Fireworks, Mistral AI, Replicate, Perplexity, HuggingFace, AI21, Bytedance, xAI, et plus |

| Magasins Vectoriels | Pinecone, Qdrant, Chroma, Milvus, Weaviate, FAISS, Elasticsearch, AstraDB, Redis, et plus |

| Bases de Données | PostgreSQL (PGVector), MongoDB, MariaDB, IBM DB2, Redis, et plus |

| Plateformes Cloud | AWS (Boto3), Azure, Google Cloud Platform, et plus |

| APIs de Recherche | Serper, Google Search, GitHub Search, GitLab Search, et plus |

| Modèles d'Embeddings | OpenAI Embeddings, Voyage AI, et plus |

Les extensions sont développées et maintenues par la communauté.

Nous accueillons les contributions. Pour commencer, veuillez consulter le fichier Contributing pour la configuration de développement et les directives.

GraphBit est construit par une merveilleuse communauté de chercheurs et d'ingénieurs.

Si vous découvrez une vulnérabilité de sécurité, veuillez la signaler de manière responsable via GitHub Security ou par e-mail plutôt que de créer un problème public.

Pour les procédures de signalement détaillées et les délais de réponse, consultez notre Security Policy.

GraphBit est sous licence selon un modèle à trois niveaux : Modèle A (Utilisation Gratuite) pour les particuliers, les institutions académiques et les petites équipes (jusqu'à 10 employés/utilisateurs), Modèle B (Essai Gratuit) pour une évaluation de 30 jours, et Modèle C (Entreprise) pour une utilisation commerciale/production. La redistribution est interdite sous tous les modèles sans une Licence Entreprise explicite.

Pour les termes et conditions complets, consultez la Full License.

Copyright © 2023–2025 InfinitiBit GmbH. All rights reserved.

Note : Cette traduction est maintenue par la communauté. Si vous trouvez des erreurs ou souhaitez améliorer la traduction, veuillez soumettre une Pull Request.